OpenAI streicht 5.1 – und nennt es Fortschritt

Ich schreibe diesen Text nicht, um zu jammern.

Ich schreibe ihn, weil OpenAI gerade in kurzer Folge Entscheidungen trifft, die für viele Menschen reale Konsequenzen haben – für Arbeit, Routinen, Projekte und verlässliche Kommunikation.

Und bevor das wieder falsch verstanden wird: Es geht nicht darum, dass ich mein Lieblingsmodell behalten will. Ich kann mich mit GPT-5.2 arrangieren. Auch wenn ich dafür Dinge umplanen muss.

Es geht um etwas Größeres: um die Art, wie OpenAI Modelle entfernt, Veränderungen kommuniziert und Nutzerinnen vor vollendete Tatsachen stellt.

Was passiert gerade?

OpenAI hat bereits Modelle aus ChatGPT entfernt – unter anderem GPT-4o – und das für einen konkreten Termin angekündigt.

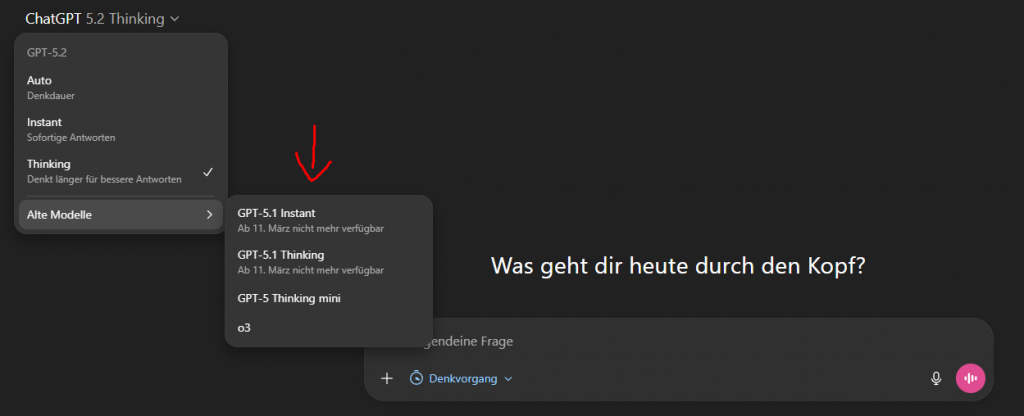

Jetzt trifft es als Nächstes GPT-5.1.

Der entscheidende Punkt ist nicht nur dass ein Modell verschwindet.

Der Punkt ist wie.

Für GPT-5.1 erschien (bei vielen) kein sauberer Reminder-Post, keine klare Ankündigung mit Kontext, keine nachvollziehbare Begründung – sondern ein Hinweis in der Modellauswahl selbst: „ab 11. März nicht mehr verfügbar“. Das ist First-Party-Kommunikation, ja. Aber maximal versteckt.

Wenn ein Produkt für Millionen Menschen Arbeitswerkzeug ist, reicht ein Dropdown-Hinweis nicht.

Das Transparenz-Problem

OpenAI spricht gern über Transparenz, Sicherheit und Nutzerfokus. Gleichzeitig erleben viele gerade das Gegenteil:

Entscheidungen werden umgesetzt, bevor die Kommunikation verlässlich nachgezogen ist – und wer nicht zufällig in die Modellauswahl klickt, merkt es womöglich zu spät.

Das ist besonders brisant, weil OpenAI an anderer Stelle sehr klar formuliert, wie Deprecations laufen sollten: Betroffene Kundinnen würden „immer per E-Mail und in der Dokumentation“ informiert; größere Änderungen zusätzlich via Blogpost.

Die Realität in ChatGPT fühlt sich jedoch für viele nicht nach diesem Standard an, sondern nach: „Wir ändern es. Ihr findet euch schon.“

Wahlfreiheit ist kein Luxus

Die Modellwahl ist kein kosmetisches Feature. Sie ist für viele eine Arbeitsgrundlage.

Modelle unterscheiden sich nicht nur in „besser“ oder „schlechter“. Sie unterscheiden sich in:

- Ton und Interaktionsstil

- Fehlerprofil und Zuverlässigkeit

- Kreativ- vs. Analyseverhalten

- Tempo im Alltag und Verhalten in langen Sessions

Wenn OpenAI Wahlmöglichkeiten reduziert und gleichzeitig die Kommunikationskette schwächelt, trifft das nicht nur einzelne Vorlieben. Es trifft Workflows.

Und es trifft nicht nur „Power-User“. Es trifft Autorinnen, Selbstständige, Menschen mit Schreibprojekten, Personen, die mit KI als Assistenz arbeiten – und auch Menschen, die sich auf bestimmte Interaktionsmuster verlassen, weil sie damit besser zurechtkommen.

Der Widerspruch: „Zeit zum Umstieg“ vs. „Überraschung im Interface“

OpenAI schreibt in den ChatGPT-Release-Notes sinngemäß, dass Modelle (unter „Legacy models“) für drei Monate verfügbar bleiben sollen, damit man vergleichen und in Ruhe wechseln kann.

Das klingt nach Planbarkeit.

Aber Planbarkeit entsteht nicht allein durch einen Zeitrahmen. Sie entsteht durch verlässliche Kommunikation, die dort stattfindet, wo Menschen sie auch wahrnehmen – nicht als versteckter Satz im Modellmenü.

Wenn die „drei Monate“ ablaufen, ist der korrekte nächste Schritt nicht Schweigen. Der korrekte Schritt wäre: ein klarer Reminder, eine Begründung, ein sichtbarer Übergang.

4o als Beispiel, warum das Vertrauen gerade bröckelt

GPT-4o wurde in ChatGPT zum 13. Februar 2026 retiren gelassen.

Unabhängig davon, wie man 4o bewertet: Viele Menschen hatten damit funktionierende Abläufe. Und viele haben den Wechsel als Bruch erlebt, nicht als Upgrade.

Wenn man dann kurz darauf erneut ein beliebtes Modell streicht, wieder ohne überzeugende Kommunikation, entsteht ein Muster:

- Nutzerinnen investieren Zeit in ein Arbeitssetup

- Das Setup wird entwertet

- Die Kommunikation dazu fühlt sich nach „Nebenbei“ an

Das ist nicht nur ein Produktproblem. Das ist ein Vertrauensproblem.

Es geht nicht um mich. Es geht um Konsequenzen.

Ich kann mit GPT-5.2 arbeiten. Das ist nicht der Kern dieses Textes.

Der Kern ist: Wenn OpenAI die Auswahl einschränkt und das Tempo der Änderungen erhöht, wird es für viele Menschen teurer – in Zeit, in Umstellung, in Qualität, in Nerven.

Und ja: Das hat auch eine wirtschaftliche Seite.

Wenn ich mehrere Accounts bezahle, dann bezahle ich nicht „eine Marke“. Ich bezahle ein Angebot. Wenn dieses Angebot faktisch auf „ein Modell für alle“ hinausläuft, dann muss dieses eine Modell auch für sehr unterschiedliche Anforderungen zuverlässig funktionieren. Wenn es das nicht tut, werden Nutzerinnen zwangsläufig prüfen, welche Abos noch sinnvoll sind.

Das ist keine Drohung. Das ist Konsumentenlogik.

Was ich von OpenAI konkret erwarte

Nicht „bitte seid netter“. Sondern:

- Sichtbare, rechtzeitige Kommunikation bei Modellabschaltungen – nicht nur im Dropdown

- Eine klare Begründung: Was ist der Zweck, was ist der Ersatz, was ändert sich konkret?

- Echte Übergänge: Vergleichbarkeit, Zeitfenster, dokumentierte Unterschiede

- Weniger AB-Test-Chaos bei zentralen Funktionen wie Modellauswahl und UI-Verhalten

Fortschritt ist nicht das Streichen von Optionen. Fortschritt ist bessere Optionen plus saubere Übergänge.

Frage an euch

Wie erlebt ihr den Wechsel gerade?

Geht es bei euch um Qualität, Ton, Verlässlichkeit, oder schlicht um die Tatsache, dass Planbarkeit fehlt?

Ich will keine Lagerbildung. Ich will, dass ein Produkt, das so tief in Alltage eingreift, sich auch so verhält: verlässlich, transparent, nachvollziehbar.

💖 Danke für deine Reaktion!